OpenAI e il Pentagono: Sam Altman Spiega i Limiti del Ruolo Aziendale nell’Utilizzo Militare dell’Intelligenza Artificiale

Indice

- Introduzione: L’Accordo OpenAI – Dipartimento della Difesa

- Il Messaggio di Sam Altman ai Dipendenti

- I Dettagli dell’Accordo: Dalle Reti non Classificate a Quelle Classificate

- Governance e Responsabilità: Chi Decide sull’Uso Militare dell’AI?

- Le Motivazioni Dietro l’Estensione dell’Accordo

- Etica e Controversie: L’AI nei Contesti Militari

- Impatto sull’Industria Tecnologica USA

- Reazioni ed Opinioni nel Settore e nell’Opinione Pubblica

- Sfide Future e Possibili Sviluppi

- Sintesi e Conclusioni

Introduzione: L’Accordo OpenAI – Dipartimento della Difesa

L’accordo recentemente siglato tra OpenAI e il Dipartimento della Difesa degli Stati Uniti (DOD) rappresenta un passaggio significativo nell’integrazione dell’intelligenza artificiale (AI) all’interno delle operazioni militari degli USA. La cooperazione tra queste due entità ha sollevato un acceso dibattito, sia all’interno dell’azienda guidata da Sam Altman, sia tra esperti di sicurezza, tecnologia e cittadini statunitensi e internazionali. Al centro della discussione vi sono i limiti etici, le politiche di governance e le possibili applicazioni degli algoritmi avanzati, soprattutto in relazione all’uso della AI nelle reti classificate e agli scenari operativi del Pentagono.

Nel marzo 2026, le dichiarazioni di Altman hanno voluto chiarire il ruolo di OpenAI, ponendo in evidenza i confini tra l’operazione aziendale e le decisioni strategiche delle forze armate americane. Questo articolo offre un’analisi dettagliata dell’accordo, delle sue implicazioni pratiche e delle controversie etiche sollevate.

Il Messaggio di Sam Altman ai Dipendenti

In risposta alle sollecitazioni interne e alle preoccupazioni emerse tra i collaboratori, Sam Altman – amministratore delegato di OpenAI – ha comunicato in modo trasparente che l’azienda non ha voce in capitolo sulle operative scelte dal Dipartimento della Difesa.

Come ha dichiarato Altman: “Non decidiamo noi come l’esercito usa l’intelligenza artificiale.”

Questa affermazione è stata inviata ufficialmente a tutti i dipendenti OpenAI, riflettendo l’approccio di chiarezza e responsabilità adottato dalla leadership aziendale in una fase di intensa collaborazione con il DOD. Altman ha sottolineato che, una volta forniti strumenti e tecnologie, le scelte sull’utilizzo concreto dell’AI e delle soluzioni software spettano unicamente alle autorità militari, in conformità con le direttive e le strategie proprie del Pentagono.

Si tratta di una presa di posizione importante rispetto alle aspettative dei lavoratori tech, spesso inclini a porsi interrogativi sugli aspetti etici e di accountability delle innovazioni in ambito militare, soprattutto quando le tecnologie fornite possono essere applicate sia in contesti civili sia per scopi difensivi o offensivi.

I Dettagli dell’Accordo: Dalle Reti non Classificate a Quelle Classificate

Un elemento cruciale è l’ampliamento del precedente contratto, del valore di circa 200 milioni di dollari, che prevedeva l’utilizzo delle tecnologie OpenAI all’interno di contesti non classificati – ovvero in ambienti considerati relativamente sicuri e non soggetti a particolari restrizioni di segretezza.

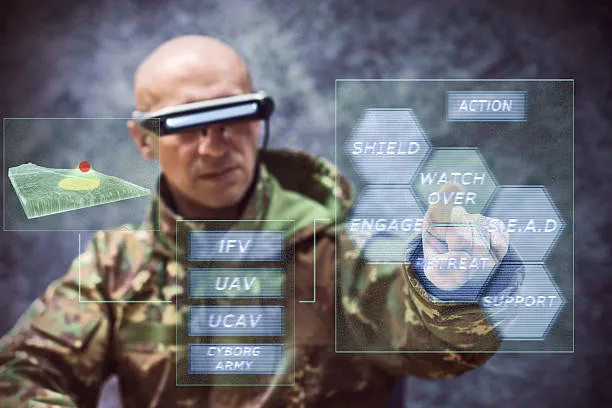

Il nuovo accordo estende ora la possibilità di applicare modelli AI, tra cui chatbot avanzati e sistemi di analisi predittiva, anche all’interno di reti classificate, quegli ambienti in cui transitano informazioni sensibili e dati top secret essenziali per la sicurezza nazionale.

Cosa Cambia con l’Accesso alle Reti Classificate?

- Maggiore potenziale di analisi e gestione dei dati riservati

- Opportunità di utilizzo per sorveglianza, difesa cyber e intelligence

- Rischi ulteriori in caso di falle o uso improprio dei sistemi

L’ampliamento contrattuale comporta vantaggi in termini di rapidità e potenza nell’elaborazione delle informazioni strategiche, ma affida altresì una maggior dose di responsabilità agli utenti finali: in questo caso, i vertici militari degli Stati Uniti.

Governance e Responsabilità: Chi Decide sull’Uso Militare dell’AI?

Nel contesto OpenAI Pentagono, la catena decisionale è chiara. Il Segretario alla Difesa – attualmente Pete Hegseth – detiene l’ultima parola riguardo alle strategie e alle applicazioni operative delle soluzioni fornite dall’azienda guidata da Altman.

Le aziende esterne, come OpenAI, possono proporre strumenti e supporto tecnico, ma la governance (in particolare sugli usi militari dell’AI) resta prerogativa esclusiva del Dipartimento della Difesa, come da prassi consolidata nelle relazioni tra settore privato e agenzie di sicurezza governative. Questo implica una separazione netta tra sviluppo tecnologico e utilizzo strategico-operativo.

Ruolo delle Policy e dei Protocolli

- Tutte le decisioni sulle modalità d’impiego vengono formalizzate a livello DOD

- Gli audit di sicurezza, i controlli etici e gli standard sono definiti dal committente pubblico

- Gli sviluppatori OpenAI non prendono parte ai comitati operativi militari

Questa configurazione mira a ridurre il rischio di conflitti di interesse e a garantire la compliance con le policy federali USA, che prevedono forme di controllo specifiche sui fornitori tecnologici civili.

Le Motivazioni Dietro l’Estensione dell’Accordo

Il crescente ricorso all’AI nei processi decisionali delle forze armate è dettato da molteplici esigenze:

- Gestione delle informazioni sensibili: l’AI può accelerare le analisi in situazioni di crisi o emergenza nazionale

- Innovazione nella difesa cyber: i modelli AI aiutano ad anticipare minacce, testare punti deboli e rafforzare la sicurezza

- Efficienza operativa: automazione di processi ripetitivi, miglioramento delle logiche decisionali e del supporto alle truppe

Caso D’Oro: Utilizzo di Sistemi AI nelle Guerre Ibride

Nell’era delle guerre caratterizzate da spionaggio digitale e manipolazione dell’informazione, la capacità di OpenAI di elaborare velocemente dati disparati offre al Pentagono un vantaggio competitivo non trascurabile. L’accordo si inserisce dunque in una più ampia strategia nazionale volta a mantenere la leadership tecnologica internazionale.

Etica e Controversie: L’AI nei Contesti Militari

Nonostante gli sforzi di trasparenza, il tema dell’eticità dell’AI in ambito militare genera accesi dibattiti. Il timore riguarda non solo l’utilizzo potenziale in contesti offensivi ma anche l’integrità dei sistemi e la possibilità che la tecnologia venga impiegata oltre le intenzioni iniziali.

Numerosi dipendenti e stakeholder – tra cui anche alcuni sviluppatori di OpenAI – hanno posto domande sulle possibili derive dell’integrazione AI-militare, temendo ricadute su diritti umani, privacy e politica estera degli USA.

Principali Critiche e Questioni Aperte:

- Mancanza di controllo continuo da parte degli sviluppatori su come il DOD utilizzi l’AI

- Rischio di sviluppo di “armi autonome” o sistemi di sorveglianza pervasive

- Preoccupazioni per l’impatto ci può essere su popolazioni civili in zone di conflitto

Da qui l’importanza di rafforzare policy etiche, audit esterni e meccanismi di verifica trasversale, oltre a un coinvolgimento costante delle istituzioni democratiche e dei garanti dei diritti civili.

Impatto sull’Industria Tecnologica USA

Il contratto sottoscritto con il Pentagono ha ricadute significative su tutto il comparto tech statunitense. La possibilità che sistemi di intelligenza artificiale di nuova generazione vengano adottati nelle difese critiche stimola sia il mercato delle startup sia i giganti tecnologici, che si muovono per non perdere terreno.

I principali effetti sull’industria:

- Aumento degli investimenti in ricerca e sviluppo su AI applicata alla difesa

- Attivazione di partnership strategiche tra pubblico e privato

- Debate acceso su proprietà intellettuale e cyber-sicurezza

Questa tendenza rafforza la posizione USA nell’arena globale, ma chiama le aziende a un maggiore rigore su sicurezza, trasparenza e compliance regolatoria.

Reazioni ed Opinioni nel Settore e nell’Opinione Pubblica

All’interno del settore tecnologico e militare, le reazioni sono state molteplici. Se da un lato vi è entusiasmo rispetto all’innovatività delle soluzioni proposte, dall’altro si osserva una crescente richiesta di accountability. Alcune associazioni per i diritti civili e gruppi anti-militarizzazione della tecnologia hanno espresso critiche aperte all’accordo, chiedendo maggiore trasparenza verso il pubblico e garanzie riguardo alla non applicabilità in contesti conflittuali indiscriminati.

Le organizzazioni sindacali dei lavoratori tecnologici monitorano con attenzione l’evoluzione degli accordi e invitano le aziende coinvolte a formalizzare codici etici stringenti e meccanismi di whistleblowing accessibili.

La stampa statunitense, infine, dedica crescente attenzione ai contratti tra dibattuto il contratto OpenAI DOD e i futuri sviluppi delle reti classificate.

Sfide Future e Possibili Sviluppi

L’evoluzione dell’AI militare porrà nei prossimi anni nuove sfide. Tra queste, si segnalano:

- La necessità di aggiornamento continuo dei protocolli di sicurezza

- La formazione degli operatori militari alle best practice AI

- Il rafforzamento dei controlli su export e replicabilità dei sistemi

Ulteriore attenzione dovrà essere posta al bilanciamento tra competitività internazionale e responsabilità etiche, nonché alla ridefinizione dei rapporti tra pubblico, privato e società civile nella governance dell’innovazione.

Gli sviluppi attesi includono:

- Lancio di nuove piattaforme AI customizzate per le esigenze militari

- Maggiore cooperazione multilaterale tra alleati NATO e aziende USA

- Incremento delle regole normative, sia a livello statale che internazionale

Sintesi e Conclusioni

L’accordo tra OpenAI e il Dipartimento della Difesa USA rappresenta uno snodo cruciale della trasformazione digitale in ambito militare. Quanto emerso dalle dichiarazioni di Sam Altman ai dipendenti mostra la volontà di distinguere con chiarezza il confine tra sviluppo tecnologico e decisione operativa, promuovendo trasparenza e responsabilità all’interno delle aziende tech.

Le sfide etiche e strategiche restano però attuali e imprescindibili: occorrerà monitorare con attenzione sia l’evoluzione degli strumenti adottati nelle reti classificate, sia i meccanismi di verifica e controllo, per evitare derive potenzialmente dannose e garantire che l’innovazione rimanga al servizio dell’interesse collettivo e dei valori democratici. Le riflessioni emerse in questa fase potranno rappresentare un modello per la futura regolazione delle tecnologie AI negli ambiti sensibili, in un quadro globale sempre più connesso e complesso.